6月3日,昆仑万维宣布开源了名为Skywork-MoE的2千亿稀疏大模型。该模型是基于其之前开源的Skywork-13B模型扩展而来,并且号称是首个完整将MoE Upcycling技术应用并落地的开源千亿MoE大模型。

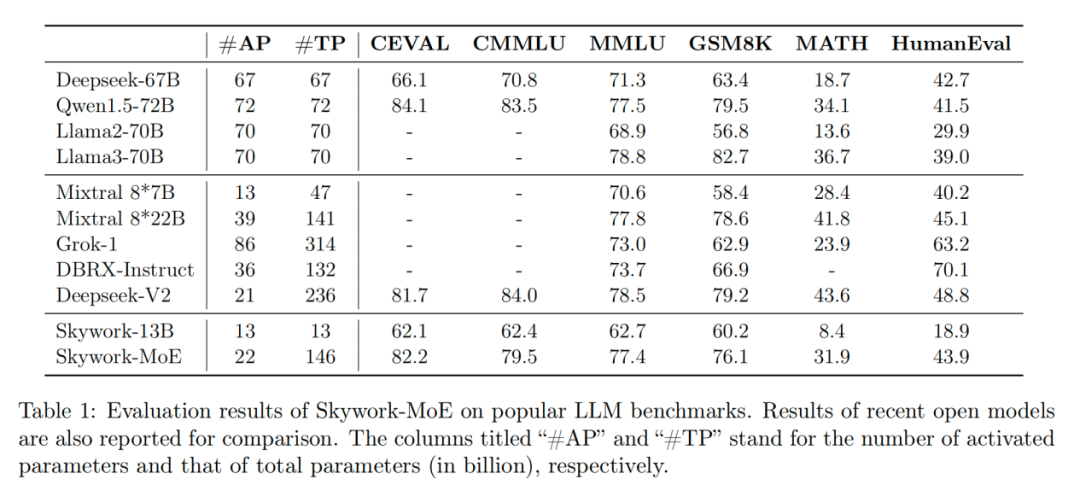

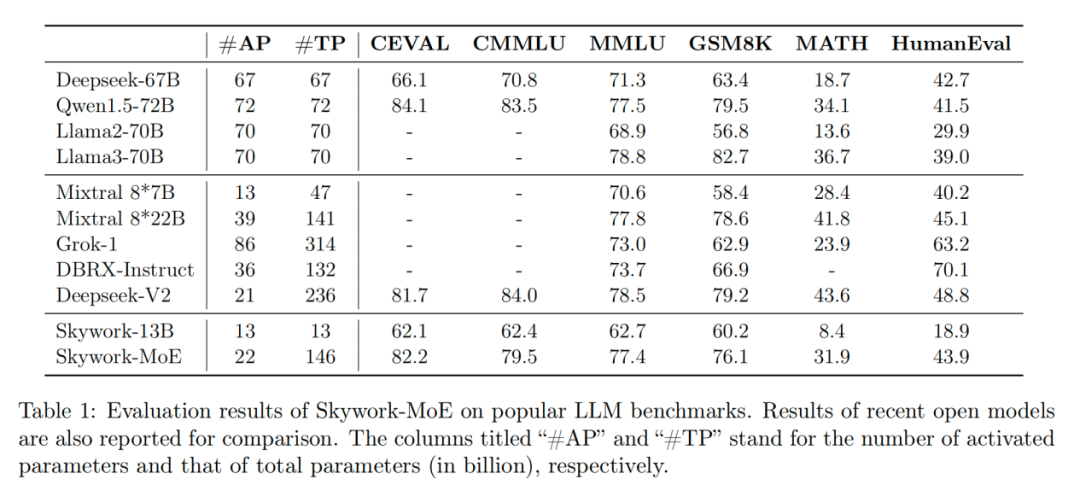

据了解,本次开源的Skywork-MoE模型属于天工3.0研发模型系列中的中档大小模型(Skywork-MoE-Medium)。该模型总参数量为146B,激活参数量为22B,共有16个Expert,每个Expert大小为13B,每次激活其中的2个Expert。

此外,天工3.0还训练了75B(Skywork-MoE-Small)和400B(Skywork-MoE-Large)两档MoE 模型,并不在此次开源之列。根据官方测试结果显示,在相同的激活参数量(推理计算量)下,Skywork-MoE能力接近70B的Dense模型,这意味着该模型的推理成本降低了近3倍。

与此同时,Skywork-MoE的总参数大小比DeepSeekV2的小三分之一。通过更小的参数规模达到相近的能力。而且整个项目都完全开源免费商用,无需申请。

值得一提的是,《天空之眼》的研发团队希望利用这个机会来进一步推动行业内的技术和产品创新,并鼓励更多开发人员参与进来共同探索人工智能领域带来更多可能性。

发表评论 取消回复